B题产品订单的数据分析与需求预测 解题思路与数据处理服务代码分享

本文旨在针对“B题产品订单的数据分析与需求预测”问题,系统阐述解题思路,并分享数据处理与分析服务的代码实现,为相关研究和实践提供参考。

一、 问题解析与总体思路

“产品订单的数据分析与需求预测”是典型的时序预测与业务分析结合的问题。核心目标通常是:基于历史订单数据,分析销售规律,并构建模型预测未来需求。解题思路可分为以下几个步骤:

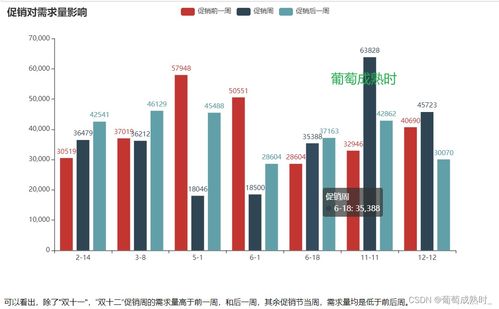

- 问题定义与目标拆解:明确预测目标(如未来N天/周/月的订单量、产品类别需求)、评估指标(如MAE, RMSE, MAPE)以及业务约束(如季节性、促销影响)。

- 数据理解与探索性分析(EDA):对提供的订单数据(可能包含时间戳、产品ID、数量、金额、客户信息等)进行完整性、一致性检查。通过可视化(如时序图、分布图、相关性热图)分析趋势、季节性、周期性和异常值。

- 数据预处理与特征工程:这是提升模型性能的关键。包括:

- 数据清洗:处理缺失值、异常值。

- 特征构造:从日期时间衍生出年、月、日、周几、季度、是否节假日、是否促销期等;构造滞后特征(如过去1天、7天、30天的销量);构造滚动统计特征(如过去7天均值、标准差);可能还包括产品属性、市场活动等外部特征。

- 数据转换:对数据进行标准化/归一化,以满足模型要求。

- 模型选择与训练:根据数据特点选择合适的预测模型。常见选择包括:

- 传统时序模型:ARIMA、SARIMA(适用于有明显趋势和季节性的单变量序列)。

- 机器学习模型:线性回归、随机森林、梯度提升树(如XGBoost, LightGBM),能有效利用构造的复杂特征。

- 深度学习模型:LSTM、GRU等循环神经网络,尤其擅长捕捉长期依赖关系。

- 集成策略:可采用模型融合(如加权平均、Stacking)来提升预测稳定性。

- 模型评估与优化:在验证集/测试集上评估模型性能,使用交叉验证避免过拟合。通过调整模型参数、优化特征组合来提升预测精度。

- 需求预测与结果分析:使用优化后的模型进行未来需求预测,并将预测结果与业务背景结合,给出可解释的分析报告,例如识别核心驱动因素、提出库存或生产建议。

二、 数据处理与分析服务代码框架分享

以下是一个基于Python的简化代码框架,集成了数据处理、特征工程、模型训练(以LightGBM为例)和评估的基本流程。

`python

import pandas as pd

import numpy as np

from datetime import datetime

import matplotlib.pyplot as plt

import seaborn as sns

from sklearn.modelselection import traintest_split, TimeSeriesSplit

from sklearn.preprocessing import StandardScaler

from sklearn.metrics import meanabsoluteerror, meansquarederror

import lightgbm as lgb

import warnings

warnings.filterwarnings('ignore')

1. 数据加载与初步查看

df = pd.readcsv('productorders.csv') # 假设数据文件

df['orderdate'] = pd.todatetime(df['orderdate']) # 转换日期格式

df.setindex('order_date', inplace=True)

print(df.head())

print(df.info())

2. 探索性数据分析(示例:绘制月度销量趋势)

monthlysales = df['quantity'].resample('M').sum()

plt.figure(figsize=(12,6))

monthlysales.plot(title='Monthly Product Order Quantity Trend')

plt.xlabel('Date')

plt.ylabel('Quantity')

plt.grid()

plt.show()

3. 数据预处理与特征工程

假设我们预测未来7天的日订单总量

TARGET = 'quantity'

FORECAST_HORIZON = 7

按天聚合数据

dailydf = df.resample('D')[TARGET].sum().resetindex()

def createfeatures(df, lags=[1, 7, 30], rollingwindows=[7, 30]):

"""

创建时序特征

"""

df = df.copy()

df['year'] = df['orderdate'].dt.year

df['month'] = df['orderdate'].dt.month

df['day'] = df['orderdate'].dt.day

df['dayofweek'] = df['orderdate'].dt.dayofweek

df['quarter'] = df['orderdate'].dt.quarter

df['isweekend'] = df['dayofweek'].apply(lambda x: 1 if x>=5 else 0)

# 滞后特征

for lag in lags:

df[f'lag_{lag}'] = df[TARGET].shift(lag)

# 滚动统计特征

for window in rollingwindows:

df[f'rollingmean{window}'] = df[TARGET].shift(1).rolling(window=window).mean()

df[f'rollingstd_{window}'] = df[TARGET].shift(1).rolling(window=window).std()

return df

dailydffeatured = createfeatures(dailydf)

# 删除因创建特征产生的缺失值行

dailydffeatured.dropna(inplace=True)

4. 准备训练数据

定义特征列(排除日期和目标列)

featurecols = [col for col in dailydffeatured.columns if col not in ['orderdate', TARGET]]

X = dailydffeatured[featurecols]

y = dailydf_featured[TARGET]

时序交叉验证分割(更符合时序数据特性)

tscv = TimeSeriesSplit(nsplits=5)

for trainindex, valindex in tscv.split(X):

Xtrain, Xval = X.iloc[trainindex], X.iloc[valindex]

ytrain, yval = y.iloc[trainindex], y.iloc[val_index]

特征标准化

scaler = StandardScaler()

Xtrainscaled = scaler.fittransform(Xtrain)

Xvalscaled = scaler.transform(X_val)

5. 训练LightGBM模型

lgbmodel = lgb.LGBMRegressor(

nestimators=200,

learningrate=0.05,

maxdepth=5,

randomstate=42

)

lgbmodel.fit(Xtrainscaled, ytrain,

evalset=[(Xvalscaled, yval)],

evalmetric='mae',

callbacks=[lgb.earlystopping(50), lgb.logevaluation(0)])

6. 模型评估

ypred = lgbmodel.predict(Xvalscaled)

mae = meanabsoluteerror(yval, ypred)

rmse = np.sqrt(meansquarederror(yval, ypred))

print(f'Validation MAE: {mae:.2f}')

print(f'Validation RMSE: {rmse:.2f}')

7. 未来需求预测(示例)

需要利用最新数据构造与训练时相同的特征

lastdata = dailydffeatured.iloc[-1:].copy()

futurepredictions = []

for i in range(FORECAST_HORIZON):

# 这里简化处理:实际中需要递归地更新滞后和滚动特征

更稳健的方法是使用专门的时序预测框架(如Prophet或Darts)

pred = lgbmodel.predict(scaler.transform(lastdata[featurecols]))[0]

futurepredictions.append(pred)

# 更新last_data中的关键滞后特征(此处为简化示意)

...

print(f'Next {FORECASTHORIZON} days forecast: {futurepredictions}')

8. (可选)特征重要性分析

lgb.plotimportance(lgbmodel, maxnumfeatures=10, figsize=(10,6))

plt.title('Feature Importance')

plt.show()`

三、 数据处理服务化建议

在实际生产或竞赛中,可以将上述流程封装成可复用的数据处理与预测服务:

- 模块化设计:将数据读取、清洗、特征工程、模型训练、预测分别封装成独立函数或类。

- 配置化:将模型参数、特征列表、滞后窗口等通过配置文件(如YAML)管理,便于调整。

- 管道(Pipeline):使用

sklearn.pipeline将预处理和模型训练步骤串联,确保数据流一致。 - 自动化与调度:对于定期预测任务,可使用Apache Airflow等工具调度整个分析预测流程。

- API服务化:使用Flask或FastAPI将训练好的模型包装成REST API,接收新数据并返回预测结果,便于集成到业务系统中。

四、

解决产品订单需求预测问题,关键在于深入的数据理解、精细的特征工程和合适的模型选择。本文提供的思路与代码框架是一个起点,在实际应用中需根据具体数据分布、业务场景进行大量调整与优化,例如引入外部变量、处理多品类序列、使用更先进的深度学习架构等。通过构建稳健的数据处理服务,可以实现预测流程的自动化与持续迭代,从而为供应链管理、库存优化等决策提供有力支持。

如若转载,请注明出处:http://www.dmbcd.com/product/11.html

更新时间:2026-05-25 00:43:03